ESET analizó la falla, que permitió por un lapso que usuarios puedan ver preguntas del historial de búsqueda de otros usuarios de ChatGPT y expuso información personal de un pequeño porcentaje de suscriptores al plan pago de este servicio, como nombre y apellido, dirección de correo asociada al pago, los últimos cuatro dígitos de la tarjeta de crédito y la fecha de expiración.

Todo comenzó el pasado 20 de marzo cuando usuarios a través de Twitter y Reddit comenzaron a reportar que en su historial preguntas aparecían consultas realizadas por otros usuarios. En algunos casos en otros idiomas. Según confirmó OpenAI en un comunicado, todo esto provocó que se suspendiera el servicio de ChatGPT por un tiempo hasta que se corrigió la falla y luego el servicio se reestableció.

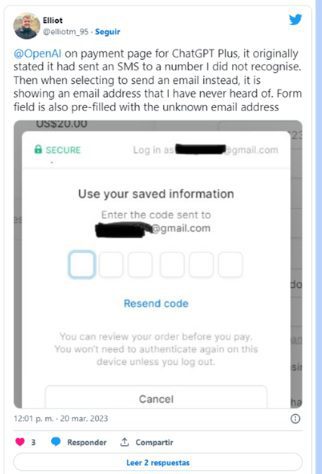

Además del historial de consultas, algunas personas también reportaron que en la página de pagos para ChatGPT Plus aparecía la dirección de correo de otros usuarios:

En el caso de los datos de pago, según explicó OpenAI, el falla afectó al 1.2% de suscriptores activos a ChatGPT Plus y si bien la información expuesta incluía los últimos cuatro dígitos de las tarjetas de crédito, en ningún caso quedaron expuestos los números completos. La compañía detrás de ChatGPT aseguró que se contactó con los usuarios afectados por la exposición de esta información y confía en que los datos personales de los usuarios ya no está en riesgo.

OpenAI confirmó que lo que provocó esta exposición de información fue una falla que radicaba en el cliente de la librería de código abierto Redis, y que envió un parche al equipo de mantenimiento de Redis que ya corrigió el error.

Además de la falla que permitió la exposición de información, se reportó a OpenAI una vulnerabilidad que permitía realizar ataques de Web Cache Deception. Esta vulnerabilidad, que ya fue corregida, permitía robar cuentas de terceros, ver el historial de consultas y acceder a los datos de pago de las cuentas.

El equipo de investigación de ESET recientemente alertó sobre distintas estafas y engaños que han circulado aprovechando el éxito de ChatGPT. Entre los ejemplos se destacó una falsa extensión para Google Chrome llamada “Quick access to Chat GPT” que los cibercriminales utilizaban para robar cuentas de Facebook, las cuales eran a su vez utilizadas para crear bots y desplegar publicidad maliciosa. Sin embargo, esta no fue la única extensión maliciosa que aprovechó el nombre de ChatGPT, ya que investigadores de Guardio revelaron una nueva variante de la misma extensión maliciosa que roba cuentas de la red social. En este caso se trata de una versión troyanizada de una extensión legítima llamada “ChatGPT for Google”.

“Como podemos ver, ChatGPT es atractiva para los actores maliciosos, ya sea para utilizar la herramienta con fines ilícitos, así como también para suplantar su identidad y engañar a personas desprevenidas. Probablemente esta tendencia continuará y seguiremos viendo casos donde se intente explotar vulnerabilidades o realizar fraudes en su nombre”, agrega Camilo Gutiérrez Amaya, Jefe del Laboratorio de investigación de ESET Latinoamérica.